4.2.2 Metodo Utilizando transformada de Laplace.

La transformada de Laplace de una función f(t) definida (en ecuaciones diferenciales, o en análisis matemático o en análisis funcional) para todos los números positivos t ≥ 0, es la funciónF(s), definida por:

siempre y cuando la integral esté definida. Cuando f(t) no es una función, sino una distribución con una singularidad en 0, la definición es:

Cuando se habla de

la transformada de Laplace, generalmente se refiere a la versión

unilateral. También existe la transformada de Laplace bilateral, que se

define como sigue:

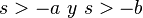

La transformada de Laplace F(s) típicamente existe para todos los números reales s > a, donde a es una constante que depende del comportamiento de crecimiento de f(t).

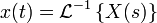

es llamado el operador de la transformada de Laplace.

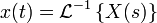

es llamado el operador de la transformada de Laplace.

PROPIEDADES

Tabla de las transformadas de Laplace mas comunes

La transformada de Laplace recibe su nombre en honor del matemático francés Pierre-Simon Laplace, que la presentó dentro de su teoría de la probabilidad. En 1744, Leonhard Euler había investigado un conjunto de integrales de la forma:

— como soluciones de ecuaciones diferenciales, pero no profundizó en ellas y pronto abandonó su investigación. Joseph Louis Lagrange,

admirador de Euler, también investigó ese tipo de integrales, y las

ligó a la teoría de la probabilidad en un trabajo sobre funciones de

densidad de probabilidad de la forma:

— que algunos historiadores interpretan como auténticas transformadas de Laplace.

Este tipo de integrales atrajeron la atención de Laplace cuando, en

1782, y siguiendo la idea de Euler, trató de emplear estas integrales

como soluciones de ecuaciones diferenciales. Parece ser que en 1785 dio

un paso más allá, y reenfocó el problema para en vez de usar las

integrales como soluciones, aplicarlas a las ecuaciones dando lugar a

las transformadas de Laplace tal y como hoy en día se entienden. Usó una

integral de la forma:

— análoga a la transformada de Mellin,

con la que transformó una ecuación diferencial en una ecuación

algebraica de la que buscó su solución. Planteó alguna de las

principales propiedades de su transformada, y de alguna forma reconoció

que el método de Joseph Fourier para resolver por medio de series de Fourier la ecuación de difusión podría relacionarse con su transformada integral para un espacio finito con soluciones periódicas.

Pese al logro, las transformadas de Laplace pronto cayeron en un

relativo olvido, al haber sido presentadas en el campo de la

probabilidad –ajeno a su moderna aplicación en la física y la

ingeniería–, y ser tratadas sobre todo como objetos matemáticos

meramente teóricos.

La moderna aplicación de las transformadas de Laplace y toda su teoría

subyaciente surge en realidad en la segunda mitad del siglo XIX. Al

tratar de resolver ecuaciones diferenciales relacionadas con la teoría

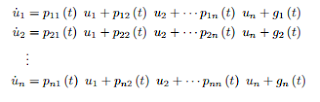

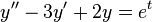

de vibraciones, el ingeniero inglés Oliver Heaviside (1850-1925) descubrió que los operadores diferenciales podían tratarse analíticamente como variables algebraicas. De acuerdo con el "cálculo operacional", si se tiene una ecuación diferencial de la forma:

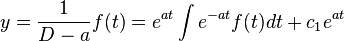

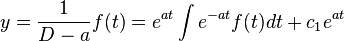

— donde D es el operador diferencial, esto es,

, entonces la solución general a dicha ecuación es de la forma:

.

.

Heaviside observó que si se trataba al operador D como una variable

algebraica, era posible alcanzar igualmente la solución de toda ecuación

pareja a la de arriba. En efecto, según la solución general, se cumple

que:

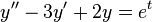

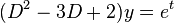

Entonces, si se considera una ecuación diferencial de segundo orden como la siguiente:

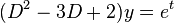

— ésta puede reescribirse en para resaltar el operador D como:

Heaviside propuso despejar y y tratar a D algebraicamente, en cuyo caso se tendría que:

Sustituyendo las fracciones en D por la expresión integral de las mismas

arriba presentada, se llega a la solución de la ecuación diferencial:

Heaviside publicó sus resultados, cuya utilidad a la hora de resolver

ecuaciones de la física y la ingeniería hizo que pronto se extendieran.

Sin embargo, el trabajo de Heaviside, formal y poco riguroso, atrajo las

críticas de algunos matemáticos puristas que los rechazaron

argumentando que los resultados de Heaviside no podían surgir de tal

forma. No obstante, el éxito del método hizo que pronto fuera adoptado

por ingenieros y físicos de todo el mundo, de manera que al final atrajo

la atención de cierto número de matemáticos tratando de justificar el

método de manera rigurosa. Tras varias décadas de intentos, se descubrió

que la Transformada descubierta por Laplace hacía un siglo no sólo

ofrecía un fundamento teórico al método de cálculo operacional de

Heaviside, sino que además ofrecía una alternativa mucho más sistemática

a tales métodos.

Hacia principios del siglo XX, la transformada de Laplace se convirtió

en una herramienta común de la teoría de vibraciones y de la teoría de

circuitos, dos de los campos donde ha sido aplicada con más éxito. En

general, la transformada es adecuada para resolver sistemas de

ecuaciones diferenciales lineales con condiciones iniciales en el

origen. Una de sus ventajas más significativas radica en que la integración y derivación se convierten en multiplicación y división.

Esto transforma las ecuaciones diferenciales e integrales en ecuaciones

polinómicas, mucho más fáciles de resolver.También se aplica en EDP y

ecuaciones diferenciales en diferencias.

[Propiedades

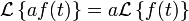

[editar]Linealidad

Derivación

=

=- =

Integración

Dualidad

Desplazamiento de la frecuencia

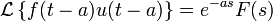

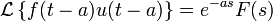

Desplazamiento temporal

Nota:

es la función escalón unitario.

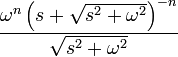

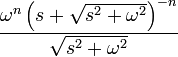

Desplazamiento potencia n-ésima

![\mathcal{L}\{\,t^nf(t)\} = (-1)^nD_s^n[F(s)]](http://upload.wikimedia.org/wikipedia/es/math/f/a/6/fa6251b315808787e499ee96b9fbb7a3.png)

Convolución

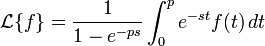

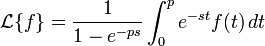

Transformada de Laplace de una función con periodo p

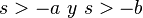

Condiciones de convergencia

(que crece más rápido que

(que crece más rápido que  ) no pueden ser obtenidas por Laplace, ya que

) no pueden ser obtenidas por Laplace, ya que  , es una función de orden exponencial de ángulos.

, es una función de orden exponencial de ángulos.

Teorema del valor inicial

Sea una función

derivable a trozos y que

Entonces :

es el conjunto de funciones continuas a trozos con orden exponencial.

Teorema del valor fina

Sea una función derivable a trozos tal que

una función derivable a trozos tal que  .Entonces :

.Entonces :

es el conjunto de funciones continuas a trozos con orden exponencial.

Tabla de las transformadas de Laplace más comunes

La siguiente tabla provee la mayoría de las transformaciones de Laplace para funciones de una sola variable.

Debido a que la transformada de Laplace es un operador lineal, la

transformada de Laplace de una suma es la suma de la transformada de

Laplace de cada término

Aquí está una lista de las transformadas más comunes. En ella

denota a la llamada función de Heaviside o

función escalón, que vale 1 cuando su argumento es positivo y 0 cuando

su argumento es negativo. Cuando su argumento vale 0 se le suele asignar

el valor 1/2, aunque esto no tiene relevancia práctica.

| ID | Función | Dominio en el tiempo

| Dominio en la frecuencia

| Región de la convergencia

para sistemas causales |

|---|

| 1 | retaso ideal |  |  |

|

| 1a | impulso unitario |  |  |  |

| 2 | enésima potencia retrasada y con

desplazamiento en la frecuencia |  |  |  |

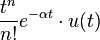

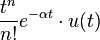

| 2a | n-ésima potencia |  |  |  |

| 2a.1 | q-ésima potencia |  |  |  |

| 2a.2 | escalón unitario |  |  |  |

| 2b | escalón unitario con retraso |  |  |  |

| 2c | Rampa |  |  |  |

| 2d | potencia n-ésima con cambio de frecuencia |  |  |  |

| 2d.1 | amortiguación exponencial |  |  |  |

| 3 | convergencia exponencial |  |  |  |

| 3b | exponencial doble |  |  |  |

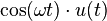

| 4 | seno |  |  |  |

| 5 | coseno |  |  |  |

| 5b | Seno con fase |  |  |  |

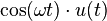

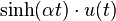

| 6 | seno hiperbólico |  |  |  |

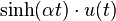

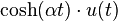

| 7 | coseno hiperbólico |  |  |  |

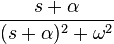

| 8 | onda senoidal con

amortiguamiento exponencial |  |  |  |

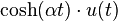

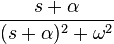

| 9 | onda cosenoidal con

amortiguamiento exponencial |  |  |  |

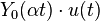

| 10 | raíz n-ésima | ![\sqrt[n]{t} \cdot u(t)](http://upload.wikimedia.org/wikipedia/es/math/4/8/6/486b3056c275d0abfe2730f87a747f9f.png) |  |  |

| 11 | logaritmo natural |  | ![- { t_0 \over s} \ [ \ \ln(t_0 s)+\gamma \ ]](http://upload.wikimedia.org/wikipedia/es/math/6/e/8/6e8a76493bbae4b1d845742deeebdb01.png) |  |

| 12 | Función de Bessel

de primer tipo,

de orden n |  |  |

|

| 13 | Función de Bessel modificada

de primer tipo,

de orden n |  |  |  |

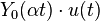

| 14 | Función de Bessel

de segundo tipo,

de orden 0 |  | | |

| 15 | Función de Bessel modificada

de segundo tipo,

de orden 0 |  | | |

| 16 | Función de error |  |  |  |

Notas explicativas:

representa la función escalón unitario. representa la función escalón unitario. representa la Delta de Dirac. representa la Delta de Dirac. representa la función gamma. representa la función gamma. es la constante de Euler-Mascheroni. es la constante de Euler-Mascheroni.

|

|

, entonces la solución general a dicha ecuación es de la forma:

, entonces la solución general a dicha ecuación es de la forma: .

.

=

=

es la función escalón unitario.

es la función escalón unitario.![\mathcal{L}\{\,t^nf(t)\} = (-1)^nD_s^n[F(s)]](http://upload.wikimedia.org/wikipedia/es/math/f/a/6/fa6251b315808787e499ee96b9fbb7a3.png)

(que crece más rápido que

(que crece más rápido que  ) no pueden ser obtenidas por Laplace, ya que

) no pueden ser obtenidas por Laplace, ya que  , es una función de orden exponencial de ángulos.

, es una función de orden exponencial de ángulos. derivable a trozos y que

derivable a trozos y que  Entonces :

Entonces :

es el conjunto de funciones continuas a trozos con orden exponencial.

es el conjunto de funciones continuas a trozos con orden exponencial.

denota a la llamada función de Heaviside o

función escalón, que vale 1 cuando su argumento es positivo y 0 cuando

su argumento es negativo. Cuando su argumento vale 0 se le suele asignar

el valor 1/2, aunque esto no tiene relevancia práctica.

denota a la llamada función de Heaviside o

función escalón, que vale 1 cuando su argumento es positivo y 0 cuando

su argumento es negativo. Cuando su argumento vale 0 se le suele asignar

el valor 1/2, aunque esto no tiene relevancia práctica.

![\sqrt[n]{t} \cdot u(t)](http://upload.wikimedia.org/wikipedia/es/math/4/8/6/486b3056c275d0abfe2730f87a747f9f.png)

![- { t_0 \over s} \ [ \ \ln(t_0 s)+\gamma \ ]](http://upload.wikimedia.org/wikipedia/es/math/6/e/8/6e8a76493bbae4b1d845742deeebdb01.png)

representa la función escalón unitario.

representa la función escalón unitario. representa la Delta de Dirac.

representa la Delta de Dirac. representa la función gamma.

representa la función gamma. es la constante de Euler-Mascheroni.

es la constante de Euler-Mascheroni.